何恺明残差学习奠基人的身份,也被“挑战”了。

为什么要说“也”?因为发起讨论的,又双叒是我们熟悉的Jürgen Schmidhuber——LSTM之父。

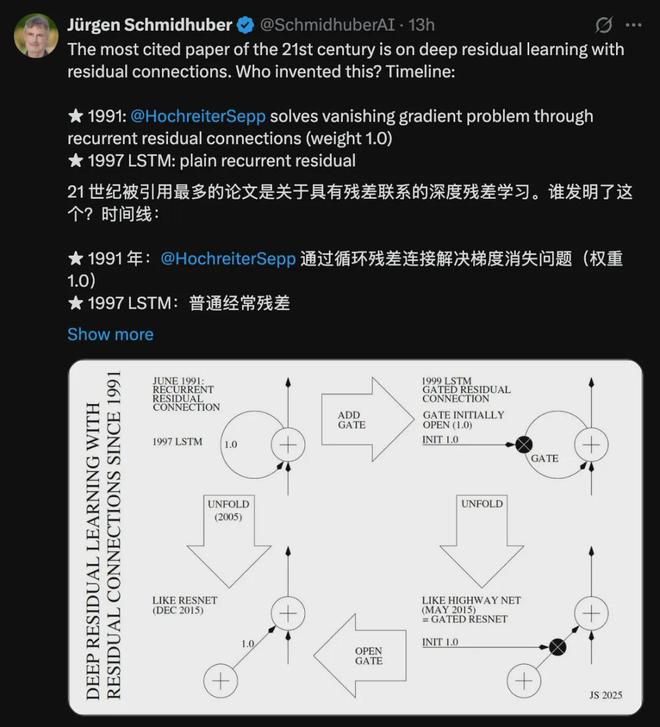

不过这一次,他不是要把功劳揽到自己身上,而是替LSTM的另一位作者Sepp Hochreiter发声:

残差学习这把改变深度学习格局的 “钥匙”,其实早在30年前就已经诞生——Sepp Hochreiter在1991年就在使用循环残差连接解决梯度消失问题。

有一说一,Jürgen争title也不是第一次了,作为深度学习的先驱者,Jürgen自认为自己的早期贡献被人为忽视了。

ResNet发布的同年,深度学习三巨头BengioHintonLeCun在Nature上联合发表有关DL的综述论文,其中大量引用他们三人的自身成果,却对Jürgen等人只字不提。

随即他们展开了长达多年的争论,尤其是在18年的图灵奖结果公布后,Jürgen更是洋洋洒洒写了篇援引200多条文献的小作文反击。

之后在GAN的原创争议上,双方也是争执不休,要知道GAN的提出者正是Bengio的得意门生。

而如今有关残差学习的创始之争,也是因为Jürgen自认为将残差学习这一成果的发现完全归因于何恺明团队有失偏颇。

不过正如网友所说:

- 从Hochreiter到ResNet,光芒随时间递归延续。阴影是被模糊的归属,但真理始终不变:1991年的种子闪耀着每一层。

30年前的第一次提出

Jürgen Schmidhube这次要讲的故事始于1991年。

当时还是Jürgen学生的Sepp Hochreiter,正在着手撰写自己的博士论文,也正是在这篇论文里,他首次系统性分析了RNN的梯度消失问题,并提出用循环残差连接解决。